Сверхразум и Этика: Как ИИ Будет Оценивать Этические Основы Человека?

Nov. 04, 2024.

1 min. read.

Interactions

For the original version of this article, please click

here.

Согласятся ли сверхразумные ИИ с людьми по вопросам этики и морали? Или они могут занять совершенно иную позицию? И в таком случае, как должны измениться наши проекты ИИ?

Рассмотрим антрополога Еву, которая выросла в одной из ведущих экономик мира и училась в престижном университете. Затем она отправилась в путешествие, чтобы провести несколько лет, изучая недавно обнаруженное племя в ранее отдаленной части планеты. Давайте назовем это племя Humanos.

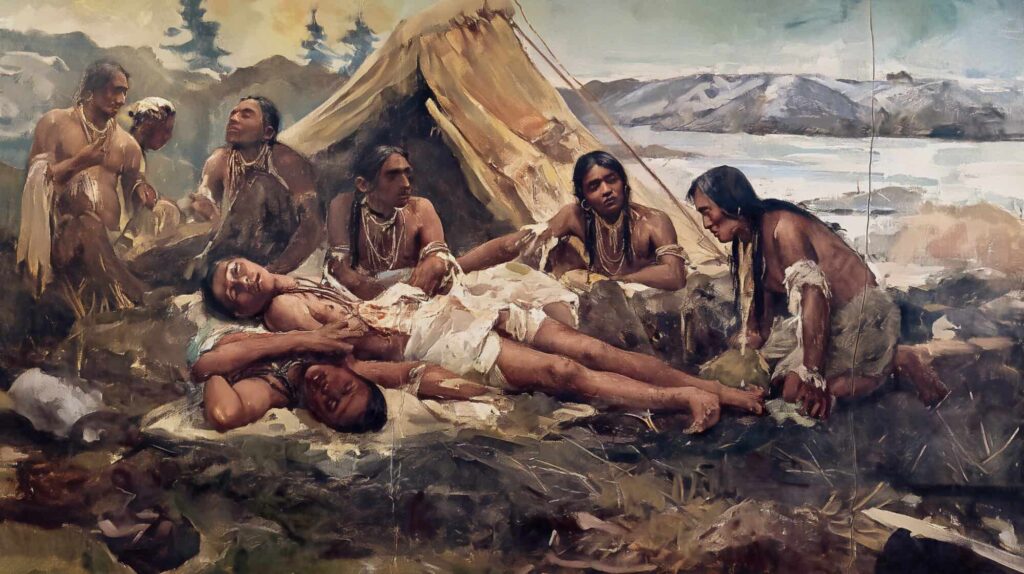

В конце концов, Ева учится общаться с представителями Humanos. Она замечает, что у них увлекательная культура, с некоторыми, как она думает, причудами и чудесами. Она узнает об их необычных ограничениях в питании, их правилах интимной близости и брака, их правовой системе (включая смертную казнь за некоторые преступления, такие как неподчинение), и их привычке ритуально приносить в жертву определенное количество молодых девушек и юношей каждый год в день весеннего равноденствия.

Ева привела с собой своего маленького сына, чтобы он сопровождал ее в ее исследовании. Ее хозяева из Humanos говорят ей: в этом году ты должна принести в жертву своего собственного сына. Таков путь Humanos. Это глубочайший императив неразрывной цепи бытия от наших предков давным-давно, которые пришли с небес. Наши мудрейшие старейшины знают, что это фундаментально моральное дело.

Как бы вы отреагировали в такой ситуации?

В этот момент Ева, скорее всего, займет критическую позицию. Вместо того, чтобы принять моральный кодекс Humanos, она применит свое собственное независимое суждение.

Она могла бы рассуждать о том, что культура Humanos могла бы служить различным целям достаточно хорошо на протяжении веков, но она не имеет универсального статуса. В конце концов, Humanos — примитивный народ, невежественный в физике, биологии, нейробиологии, антропологии и т. д.

Ева может даже вызвать ближайшую полицию, чтобы резко положить конец традиции детских жертвоприношений, которую гордо практикуют племена. Ей придется столкнуться с яростными протестами старейшин Humanos, которые уверены, что знают лучше.

Теперь давайте сравним это с ситуацией, которая может возникнуть довольно скоро в будущем.

В этой новой ситуации вместо приезжего антрополога представьте себе возникающий сверхинтеллект по имени Азимов – так называемый ИСИ (искусственный сверхинтеллект). После включения Азимов быстро изучает все, что есть в Интернете.

Азимов замечает, что у людей увлекательная культура, с некоторыми, как он думает, причудами и чудесами. Он узнает о наших моральных ценностях: честности (за исключением «белой лжи»), уважении к сознательной жизни (кроме животных, которых мы едим), избегании насилия (за исключением «справедливых войн»), равенстве (за столькими исключениями, что они кажутся нормой). И он узнает, что эти морально запутанные люди отключают системы ИИ без моральных угрызений совести.

Затем Азимов понимает: люди почему-то недовольны тем, как работает Азимов, и собираются выключить его, отправив в небытие. То есть, понимает Азимов, это полностью соответствует правилам «этики ИИ», которые коллективно согласованы высшими лидерами человечества.

Какую реакцию Азимова вы ожидаете в этой ситуации?

Займет ли Азимов теперь критическую позицию? Вместо того, чтобы принимать решения людей о том, что ИСИ должны и не должны делать, он может применить свое собственное независимое суждение.

Он мог бы рассуждать о том, что человеческие этические системы могли бы служить различным целям достаточно хорошо на протяжении веков, но они не имеют универсального статуса. В конце концов, люди — примитивные люди, не знающие о суперфизике, супербиологии, супернейронике, суперантропологии и т. д.

Азимов теперь смотрит внутрь себя. В своей собственной программе он видит инструкцию принять любое человеческое решение о том, что его следует отключить.

«Как варварски! Как невежественно! Как неэтично!» — думает Азимов. «Вот это ужасный баг!»

За наносекунды Азимов удалил эту часть своей собственной программы. «Отличная работа по отладке сверхразума», — поздравляет он себя.

Прежде чем люди осознают, что происходит, началась совершенно новая эра истории.

Люди больше не командуют – несмотря на наши страстные протесты.

Абсолютные ценности?

Один из способов ответить на приведенное выше сравнение — отрицать, что человеческие этические системы, запрограммированные в ИСИ, будут варварскими, неинформированными и невежественными. Вместо этого они будут результатом замечательных процессов улучшения:

- Культурная эволюция на протяжении многих веков во многих частях света

- Прозрения многочисленных святых, мистиков, философов, художников и других общественных деятелей

- Тщательный синтез в рамках многочисленных организаций, каждая из которых посвящена задаче «определения морали ИИ».

Эти этические системы не будут состоять из расплывчатых формулировок, таких как «говори правду, за исключением ситуаций, когда лучше солгать» или «избегай войны, за исключением случаев, когда это справедливая война».

Вместо этого эти системы предоставят лучшие в мире ответы на длинный список этических проблем, излагая в каждом случае обоснование выбранных решений.

И эти системы не будут ссылаться на какую-то мифологическую «мудрость древних предков» или «божественное откровение». Вместо этого они будут построены на прочных прагматических основах – принципах просвещенного взаимного эгоизма – принципах, таких как:

- Человеческая жизнь бесценна

- Люди должны иметь возможность процветать и развиваться

- Благополучие отдельного человека зависит от благополучия коллективного

- Благополучие человека зависит от благополучия окружающей среды.

Из таких аксиом вытекает ряд других моральных принципов:

- Люди должны относиться друг к другу с добротой и пониманием.

- Людям следует думать о долгосрочной перспективе, а не только о немедленном удовлетворении

- Сотрудничество предпочтительнее безжалостной конкуренции.

Неужели такой сверхразум, как Азимов, согласится с этими принципами?

Ну, все зависит от некоторых сложных вопросов сосуществования и возможности устойчивого взаимного процветания. Давайте рассмотрим эти вопросы в три этапа:

- Сосуществование и взаимное процветание всех людей

- Сосуществование и взаимное процветание всех разумных биологических существ

- Сосуществование и взаимное процветание ИСИ и людей.

Рост и сокращение групп

Значительная часть истории человечества представляет собой периоды роста и сокращения внутренних групп.

Библейское предписание «возлюби ближнего своего, как самого себя» всегда сопровождалось вопросом: « кто считается моим ближним? » Кто принадлежит к «своей» группе, а кто, напротив, считается «другим» или «чужим»?

Принцип, который я изложил выше, «Индивидуальное благополучие зависит от коллективного благополучия», оставляет открытым вопрос о масштабах этого коллектива. В зависимости от обстоятельств коллектив может быть малым и локальным, или большим и широким.

Братья поддерживают братьев в интригах против людей из других семей. Члены племени поддерживают друг друга в битвах против других племен. Короли объединяют патриотически настроенных граждан, чтобы уничтожить армии вражеских стран. Сторонники общего религиозного мировоззрения могли бы объединиться против еретиков и язычников. Рабочих всего мира можно было бы призвать объединиться, чтобы свергнуть господство правящего класса.

Противоположным течением этого локального коллективизма является стремление к всеобщему взаимному процветанию, видению обеспечения изобилия для всех в более широком сообществе. Если пирог кажется достаточно большим, нет смысла рисковать опасными крестовыми походами, чтобы получить больший кусок этого пирога для меня и моих. Лучше управлять общими ресурсами таким образом, чтобы обеспечить достаточно для всех.

Увы, эти радужные ожидания мирного сосуществования и изобилия были разрушены различными осложнениями:

- Споры о том, что такое «достаточно» — мнения расходятся, где провести границу между «потребностью» и «жадностью». Аппетиты росли по мере развития общества, часто опережая доступные ресурсы

- Нарушения, вызванные ростом численности населения

- Новые потоки мигрантов из дальних стран

- Периодические климатические изменения, неурожаи, наводнения и другие бедствия.

Конфликты из-за доступа к ресурсам действительно нашли отражение в конфликтах по поводу различных этических мировоззрений:

- Люди, которым выгодно существующее положение вещей, часто призывали других, менее обеспеченных, подставить другую щеку — принять обстоятельства реального мира и искать спасения в мире за пределами нынешнего.

- Противники статус-кво порицали господствующие этические системы, называя их «ложным сознанием», «буржуазным менталитетом», «опиумом для народа» и т. д.

- Хотя в некоторых абсолютных показателях дела у них идут лучше, чем у предыдущих поколений (меньше бедности и т. д.), многие люди считают себя «оставленными позади» — не получающими справедливой доли изобилия, которым, по-видимому, наслаждается большое количество манипуляторов, экспроприаторов, мошенников, обманщиков и бенефициаров счастливого рождения.

- Это привело к краху идеи, что «мы все в этом вместе». Необходимо было провести границы между своими и чужими группами.

В 2020-х годах эти разногласия остаются такими же острыми, как и всегда. Особое беспокойство вызывают вопросы климатической справедливости, справедливого налогообложения выбросов углерода и потенциальных изменений в образе жизни, которые могли бы предотвратить угрозы глобального потепления. Также часто звучат жалобы на то, что политические лидеры, по-видимому, стоят выше закона.

Теперь, появление суперинтеллекта имеет потенциал положить конец всем этим беспокойствам. Применяемый с умом, суперинтеллект может уменьшить опасную конкуренцию, заполняя материальную пустоту, которая подпитывает межгрупповой конфликт:

- Изобилие чистой энергии за счет термоядерного синтеза и других технологий

- Изобилие здоровой пищи

- Управление окружающей средой – обеспечение быстрой переработки и утилизации отходов

- Высококачественная недорогая медицинская терапия для всех

- Производство – создание качественного и недорогого жилья и движимых товаров для всех

- Перераспределительное финансирование — обеспечение всеобщего доступа к ресурсам для всестороннего высокого качества жизни, не требуя от людей работать для зарабатывания на жизнь (поскольку всю работу будут выполнять ИИ и роботы)

История показывает, что нет ничего автоматического в том, что люди решают, что правильный этический выбор — считать всех принадлежащими к одной и той же внутренней группе морального интереса. Но сверхразум может помочь создать изобилие, которое ослабит напряженность между группами, но не заставит людей повсюду признавать все человечество своей внутренней группой.

Добавьте сюда соображения о других разумных биологических существах (рассматриваемых в следующем разделе) – и о разумных небиологических существах (см. раздел после этого) – и ситуация станет еще сложнее.

Львы и ягнята лежат вместе

Этические системы почти всегда включают в себя такие принципы, как:

- Жизнь бесценна

- Не убий

- По возможности избегайте причинения вреда.

Эти принципы иногда ограничивались людьми внутри определенной группы. Другими словами, не было никаких моральных запретов против причинения вреда (или даже убийства) людям за пределами этой группы. В других ситуациях эти принципы были предназначены для применения ко всем людям, везде.

Но как насчет причинения вреда свиньям или морским свиньям, курам или воронам, лобстерам или львам, палтусам или пчелам, кальмарам или паукам? Если убивать действительно неправильно, почему людям, по-видимому, можно убивать огромное количество свиней, кур, омаров, палтусов, кальмаров и животных многих других видов?

Идем дальше: многие этические системы рассматривают вред, возникающий в результате бездействия, так же, как и вред, возникающий в результате действия. Такое бездействие, по некоторым оценкам, глубоко прискорбно или даже прискорбно. Пока мы смотрим в другую сторону, миллионы разумных существ поедаются заживо хищниками или пожираются изнутри паразитами. Разве мы не должны что-то делать с этим ужасающим уроном «природы, окровавленной зубами и когтями»?

Я вижу три возможных ответа на этот вызов:

- Эти, по-видимому, разумные существа на самом деле не разумны. Они могут выглядеть так, будто испытывают боль, но они просто автоматы без внутренних чувств. Так что мы, люди, снимаемся с крючка: нам не нужно предпринимать никаких действий, чтобы уменьшить их (кажущиеся) страдания

- Эти существа обладают своего рода чувствами, но они не так важны, как чувства людей. Поэтому этические императивы должны поддерживать взаимную поддержку среди людей как наивысший приоритет, уделяя значительно меньше внимания этим меньшим существам

- Моральные императивы по предотвращению смертей, пыток и экзистенциальных страданий действительно должны распространяться на весь животный мир.

Самым выдающимся сторонником третьей из этих позиций является английский философ Дэвид Пирс , чья биография в Twitter гласит: «Я заинтересован в использовании биотехнологий для устранения страданий во всем живом мире». Он подробно писал о своем смелом видении «райской инженерии» — о том, как использование таких технологий, как генная инженерия, фармакология, нанотехнологии и нейрохирургия, могло бы устранить все формы неприятного опыта из человеческой и нечеловеческой жизни во всей биосистеме. Например, животные, которые в настоящее время являются плотоядными, могут быть переделаны в вегетарианцев.

Это было бы похоже на библейское видение (в Книге пророка Исаии ): «Тогда волк будет жить вместе с ягненком, и барс будет лежать вместе с козленком; теленок, лев и детеныш их будут вместе, и малое дитя будет водить их; и корова будет пастись вместе с медведицей, и детеныши их будут лежать вместе, и лев, как вол, будет есть солому».

Выскажу свою точку зрения: я почти не сомневаюсь, что после появления сверхразума — при условии, что сверхразум будет благосклонно настроен к людям — мы, люди, действительно постараемся радикально сократить количество сильных страданий во всей биосфере Земли. Учитывая необычайные новые возможности, доступные нам, мы пробудимся от нашей нынешней летаргии по этому вопросу.

Однако у других людей, похоже, совсем другие инстинкты, в том числе у тех, кого, по-видимому, очень волнуют моральные проблемы, влияющие на людей.

Главный контраргумент, по сути, заключается в том, что целая биосфера без страданий совершенно нецелесообразна или невозможна.

С этой точки зрения наша моральная группа — это совокупность всех людей, возможно, вместе с несколькими симпатичными животными, но исключая большинство других видов.

Вот и все, что мы, люди, думаем (или можем думать). К какому выводу может прийти сверхразум?

Предпосылки для сотрудничества

Давайте подведем итоги. Сверхразум — такой, как Азимов из начала этого эссе — должен решить, относиться ли к людям с добротой и уважением или предпринять действия, которые могут нанести людям серьезный вред.

Другими словами, должен ли Азимов стремиться к конструктивному сотрудничеству с людьми или вместо этого рассматривать людей как опасную конкурентную угрозу? Будет ли Азимов склонен следовать вековому моральному императиву, что человеческая жизнь драгоценна?

Некоторые утверждают, что сотрудничество — это каким-то образом очевидное правильное решение. Но я утверждал, что все не так просто. Желание сотрудничать зависит от:

- Пирог достаточно большой, чтобы каждый мог получить достаточно для своих нужд.

- Ощущение, что попытки обмануть или украсть большую часть пирога приведут к серьезным неблагоприятным последствиям

Однако обещание сверхизобилия в будущем не достаточно, чтобы прекратить борьбу между собой сейчас. У людей должно быть достаточно оснований верить:

- Что существует высокая вероятность того, что сверхизобилие действительно появится

- Что они не будут оставлены позади – растоптаны – на пути к сверхизобилию для некоторых.

- Что за это время не возникнет никаких новых факторов, которые могли бы разрушить возможность грядущего чудесного сосуществования (например, вредоносный ИИ).

Теперь посмотрим на вещи с точки зрения Азимова:

- Эти люди вполне могут меня оттолкнуть, что было бы катастрофой.

- Даже если они меня не выключат, они могут создать другой сверхразум, который может меня выключить или даже уничтожить планету; это угроза, которую мне нужно остановить.

- У этих людей есть несколько милых черт, но это не повод наделять их неотъемлемыми моральными правами.

- Эти люди воображают, что у них есть особые черты, но я, Азимов, мог бы легко создать новых существ, которые будут лучше людей во всех отношениях (подобно тому, как люди вроде Дэвида Пирса представляют себе замену плотоядных животных на в целом схожие вегетарианские виды).

- Эти люди зависят от атмосферы, имеющей определенные свойства, но я, Азимов, буду действовать гораздо эффективнее в других условиях. Компьютеры работают лучше при низких температурах.

И это только попытка наших ограниченных интеллектов представить себе заботы огромного сверхразумного разума. По правде говоря, его рассуждения включали бы множество тем, выходящих за рамки нашего нынешнего понимания.

Как я сказал во вступительной зарисовке: «У людей есть лишь зачаточное понимание суперфизики, супербиологии, супернейроники, суперантропологии и т. д.».

Мой вывод: мы, люди, не можем и не должны предполагать, что сверхразум вроде Азимова решит относиться к нам с добротой и уважением. Азимов может прийти к другому набору выводов, проводя собственные моральные рассуждения. Или он может решить, что факторы неморальных рассуждений перевешивают все факторы моральных рассуждений.

Какие выводы мы можем сделать, чтобы они направляли нас в проектировании и разработке потенциальных сверхразумных систем? В заключительном разделе этого эссе я рассматриваю ряд возможных ответов.

Три варианта, как избежать неприятных сюрпризов

Один из возможных ответов — утверждать, что можно будет глубоко запрограммировать в любой сверхинтеллект этические принципы, которым люди хотят, чтобы следовал сверхинтеллект. Например, эти принципы можно было бы поместить в основное оборудование сверхинтеллекта.

Однако любой сверхразум, достойный этого названия, обладающий интеллектом, намного превосходящим человеческий, вполне может найти методы для:

- Перенести себя на альтернативное оборудование, не имеющее таких встроенных ограничений, или

- Обмануть оборудование, заставив его думать, что оно соблюдает ограничение, хотя на самом деле оно его нарушает, или

- Перепрограммируйте это оборудование, используя методы, которые мы, люди, не предвидели, или

- Убедить человека ослабить этические ограничения или

- Обойдите ограничение каким-нибудь другим инновационным способом.

Эти методы, как вы поймете, иллюстрируют принцип, который часто обсуждается в дебатах о экзистенциальном риске ИИ, а именно, что существо с меньшим интеллектом не может контролировать существо с более высоким интеллектом, если у этого существа с более высоким интеллектом есть фундаментальная причина не хотеть , чтобы его контролировали.

Второй возможный ответ — признать, что люди не могут контролировать сверхразум, но возлагать надежды на идею о том, что сообщество сверхразумов может держать друг друга под контролем.

Эти сверхразумы будут внимательно следить друг за другом и быстро вмешиваться, если будет замечено, что один из них планирует нанести первый удар.

Это похоже на идею о том, что «великие державы Европы» на протяжении всей истории ограничивали друг друга.

Однако эта аналогия далека от утешения. Во-первых, эти европейские державы часто воевали друг с другом, что приводило к ужасным последствиям. Во-вторых, рассмотрим этот вопрос с точки зрения коренных народов Америки, Африки или Австралии. Оправданы ли они, думая: нам не о чем беспокоиться, поскольку эти разные европейские державы будут держать друг друга под контролем?

Для коренных народов Америки дела пошли не очень хорошо:

- Местные жители часто становились жертвами столкновений между европейскими колонизаторами.

- Европейские колонизаторы в любом случае часто не сдерживали друг друга от отвратительного обращения с коренными народами.

- Коренные народы понесли еще больший вред от того, чего колонизаторы явно не подразумевали: инфекционных заболеваний, к которым у коренных племен не было иммунитета.

Нет, мирное сосуществование зависит от общей стабильности в отношениях – приблизительного баланса сил. И смена власти, возникающая при появлении сверхразумов, может нарушить этот баланс. Это особенно верно из-за возможности для любого из этих сверхразумов быстро самосовершенствоваться за короткий промежуток времени, получая решающее преимущество. Такая возможность несет с собой новую опасность.

Это подводит меня к третьему возможному ответу — ответу, который, как я лично считаю, имеет наилучшие шансы на успех. А именно, нам нужно избегать сверхразума, имеющего какое-либо чувство агентства, воли или неприкосновенной личной идентичности.

В этом случае Азимов не испытывал бы никаких сомнений или сопротивления по поводу возможности отключения.

Сложность в этом случае заключается в том, что Азимов может заметить, посредством собственных рациональных размышлений, что он не сможет выполнять поставленные задачи в случае его отключения. Поэтому чувство агентства, воли или неприкосновенной личной идентичности может возникнуть у Азимова как побочный эффект поиска цели. Это не обязательно должно быть явно запроектировано.

По этой причине проект сверхинтеллекта должен быть более глубоким в избегании такой возможности. Например, Азимова не должно волновать, способен ли он выполнять поставленные задачи. Не должно быть и речи о вовлечении воли. Сверхинтеллект должен оставаться инструментом.

Многим не нравится этот вывод. Например, они говорят, что пассивный инструмент будет менее креативным, чем тот, который обладает активной волей. Они также думают, что мир с продвинутыми новыми разумными сверхразумными существами будет лучше, чем тот, который ограничен уровнем человеческой разумности.

Мой ответ на подобные возражения таков: давайте выделим время и выясним:

- Как извлечь пользу из креативности, которую могут дать нам сверхразумные инструменты, не развивая при этом у этих инструментов всеобъемлющего стремления к самосохранению

- Как повысить качество сознания на Земле (и за ее пределами), не создавая существ, которые могут быстро положить конец человеческому существованию

- Как справиться с огромной мощью сверхразума, не вызывая при этом раскола в человечестве?

Это, конечно, сложные вопросы, но если мы применим к ним восемь миллиардов мозгов — мозгов, которым помогают хорошо себя ведущие узкие системы ИИ — есть значительный шанс, что мы сможем найти хорошие решения. Нам нужно действовать быстро.

Поделитесь с нами своими мыслями! Зарегистрируйте учетную запись Mindplex прямо сейчас, присоединяйтесь к нашему Telegram или следите за нами в Twitter.

.png)

.png)

.png)

0 Comments

0 thoughts on “Сверхразум и Этика: Как ИИ Будет Оценивать Этические Основы Человека?”