Опасный ярлык

Представьте, если бы я сказал: “Некоторые христиане отрицают реальность биологической эволюции, поэтому все христиане отрицают реальность биологической эволюции”.

Или что некоторые мусульмане считают, что вероотступников следует предавать смерти, поэтому все мусульмане разделяют это убеждение.

Или что некоторые атеисты (например, Сталин и Мао) стали причиной гибели миллионов людей, поэтому сам атеизм является убийственной идеологией.

Или, ближе к дому (для меня: я вырос в Абердиншире, Шотландия), – что, поскольку некоторые шотландцы жестоки с деньгами, следовательно, все шотландцы жестоки с деньгами. (В самой Шотландии этот недобрый стереотип существует с изюминкой: якобы все абердонцы злые на деньги). о всех этих случаях вы скажете, что это необоснованное навешивание ярлыков. Распространение таких стереотипов опасно. Они мешают более полному анализу и глубокому восприятию. В реальной жизни люди гораздо разнообразнее. В любом сообществе есть свое разнообразие.

Меня также шокирует другой случай навешивания ярлыков. Это касается ленивой концепции TESCREAL – концепции, которая фигурировала в недавней статье на Mindplex Magazine, озаглавленной TESCREALism: Has The Silicon Valley Ruling Class Gone To Crazy Town? Эмиль Торрес в беседе с Р. У. Сириусом.

Когда я прочитал статью, моей первой мыслью было: “Неужели Mindplex отправилась в Сумасшедший город!”.

Концепция TESCREAL, которая неоднократно продвигалась в различных местах в последние месяцы, сводит богатый и разнообразный набор идей к чрезмерно упрощенному выводу. Она предполагает, что худшие стороны любых людей, придерживающихся любого из убеждений, объединенных в этот предполагаемый набор идей, можно с уверенностью приписать другим людям, придерживающимся лишь некоторых из этих идей.

Хуже того, он предполагает, что весь “правящий класс” Кремниевой долины придерживается худших из этих убеждений.

Это как если бы я выбрал случайного атеиста и заявил, что он такой же убийца, как Сталин или Мао.

Или если бы я выбрал случайного мусульманина и заявил, что он желает смерти каждому человеку (вероотступнику), выросшему в мусульманской вере и впоследствии оставившему ее.

Вместо такого сокращения идей мир сегодня нуждается в непредвзятом исследовании широкого спектра сложных и тонких идей.

Не жажда крови, которая, похоже, движет сторонниками анализа TESCREAL.

Не разжигание ненависти к предпринимателям и технологам, которые создают множество замечательных продуктов в Кремниевой долине – людям, которые, да, нуждаются в ответственности за некоторые из своих поступков, но которые ни в коем случае не являются единым лагерем!

Я Т, но не Л.

Возьмем один пример – меня.

Я публично идентифицирую себя как трансгуманист – “Т” из TESCREAL.

Слово “трансгуманист” присутствует на обложке одной из моих книг, а родственное слово “трансгуманизм” – на обложке другой.

Так получилось, что я также был руководителем технологического подразделения. В основном я работал в Лондоне, но в мои обязанности входил надзор за сотрудниками офиса Symbian в Редвуд-Сити в Кремниевой долине. Вместе мы представляли себе, как новомодные устройства под названием “смартфоны” могут со временем улучшить многие аспекты жизни пользователей. (А еще мы размышляли о некоторых потенциальных минусах, включая риски нарушения безопасности и конфиденциальности, поэтому я и выступал за новый дизайн ядра Symbian OS с точки зрения “безопасности платформы”. Но я отвлекаюсь.)

Раз я “Т”, значит ли это, что я еще и ЭСКРЕАЛЬНЫЙ?

Давайте посмотрим на последнюю букву “Л”. Лонгтермизм. Эта буква является критической для многих аргументов, приводимых людьми, которым нравится анализ TESCREAL.

Лонгтермизм” – это вера в то, что потребности потенциально огромного количества еще не рожденных (и не зачатых) людей в будущих поколениях могут перевесить потребности ныне живущих людей.

Что ж, я не придерживаюсь этого мнения. Я не руководствуюсь ею в своих решениях.

Меня мотивирует возможность технологий значительно улучшить жизнь каждого человека в мире, живущего сегодня. А также необходимость предвидеть и предотвращать возможные катастрофы.

Под “катастрофой” я подразумеваю все, что убьет большое количество ныне живущих людей.

Смерть 100 % ныне живущих уничтожит будущее человечества, а смерть 90 % людей – нет. Долгожители любят указывать на это, и хотя теоретически это верно, это не дает никакого оправдания игнорированию потребностей нынешних людей ради повышения вероятности рождения большего числа будущих людей.

Некоторые люди говорят, что их убеждают аргументы долгосрочников. Но я подозреваю, что это лишь небольшое меньшинство довольно интеллектуальных людей. Мой опыт общения с людьми в Кремниевой долине и с другими людьми, которые разрабатывают и создают новые технологии, показывает, что эти абстрактные долгосрочные соображения не являются руководством для принятия повседневных решений. Отнюдь.

Концепции сложны

Здесь необходимо отметить более важный момент. Такие понятия, как “трансгуманизм” и “долгожительство”, воплощают в себе богатое разнообразие.

То же самое можно сказать и о других компонентах предполагаемой связки TESCREAL: E – экстрапианизм, S – сингуляритаризм, C – космизм, R – рационализм, EA – эффективный альтруизм.

В каждом случае следует избегать сократизма – думать, что если вы слышали, как один человек, защищающий данную философию, высказал одно мнение, то можно сделать вывод, что он думает по всем остальным вопросам. На практике люди сложнее – и идеи сложнее.

Как мне кажется, отдельные части каждой из философий T, E, S, C, R и EA заслуживают широкого внимания и поддержки. Но если вы настроены враждебно и немного покопаетесь, то легко найдете людей из сообществ, окружающих каждый из этих терминов, которые сказали что-то презрительное или пугающее. А затем вы можете (лениво) навесить ярлык на всех остальных в этом сообществе с теми же нежелательными чертами. (“Видел одного, видел всех!”).

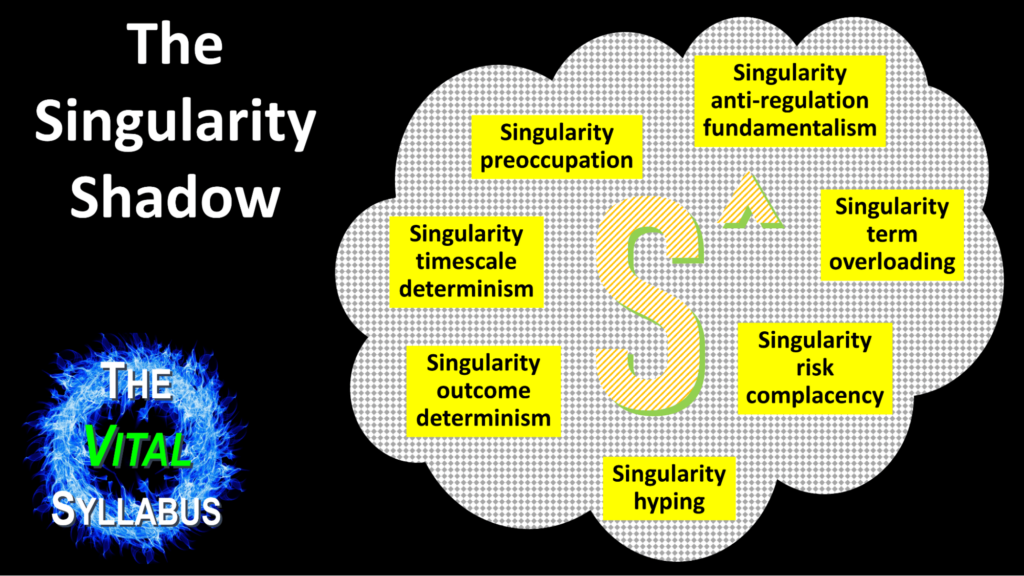

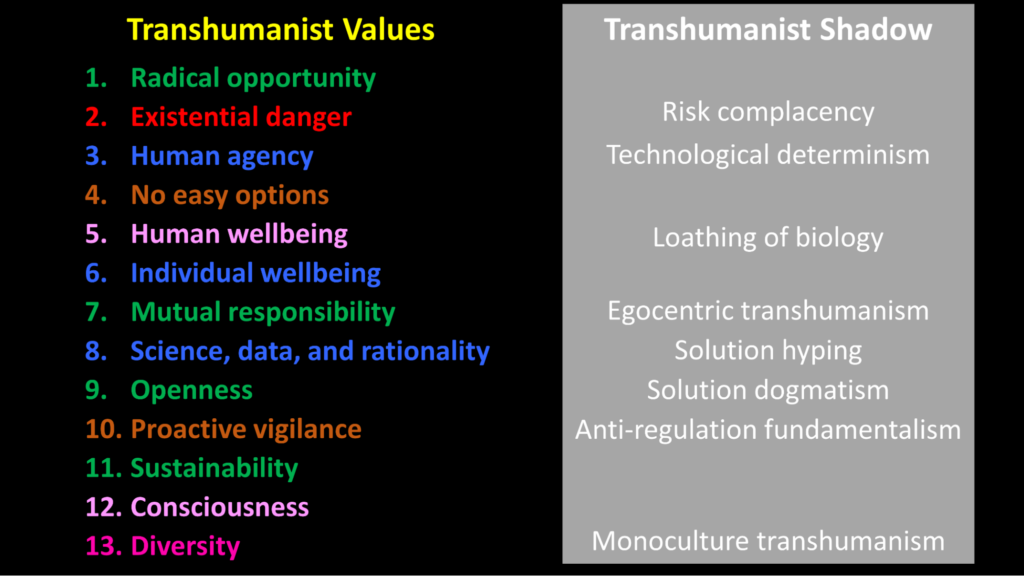

В этих расширенных сообществах действительно есть люди с нежелательными чертами. Действительно, каждый из T и S привлек то, что я называю “тенью” – набор связанных с ним убеждений и установок, которые являются отклонениями от ценных основных идей философии. Вот изображение тени Сингулярности, которое я использую:

А вот изображение тени трансгуманиста:

(В обоих случаях вы можете нажать на ссылки в подписях, чтобы посмотреть видео, в котором представлен более полный анализ).

Как видите, черты трансгуманистической тени возникают, когда люди не поддерживают то, что я перечислил как “трансгуманистические ценности”.

Существование этих теней неоспоримо, и это прискорбно. Их убеждения и взгляды могут удержать независимых наблюдателей от серьезного отношения к основной философии.

В таком случае, спросите вы, зачем продолжать использовать основные термины “трансгуманизм” и “сингулярность”? Потому что в обеих этих философиях есть очень важные позитивные идеи! Давайте обратимся к ним.

Самое важное предвидение

Вот мое резюме из 33 слов о самом важном предвидении, которое я могу предложить:

Надвигающиеся волны технологических изменений способны привести либо к глобальному разрушению, либо к райскому устойчивому сверхизбытку, причем результат будет зависеть от своевременного возвышения трансгуманистического видения, трансгуманистической политики и трансгуманистического образования.

Давайте рассмотрим это еще раз, на этот раз более медленно.

Прежде всего. Технологические изменения в ближайшие несколько десятилетий приведут к тому, что в руках миллиардов людей окажется огромная новая сила. Вместо того чтобы фокусироваться на последствиях сегодняшних технологий – хотя они и значительны, – нам нужно обратить внимание на еще более масштабные последствия технологий ближайшего будущего.

Во-вторых, эти технологии увеличат риски гуманитарных катастроф. Если мы уже сегодня обеспокоены этими рисками (как и должно быть), мы должны быть еще более обеспокоены тем, как они будут развиваться в ближайшем будущем.

В-третьих, тот же набор технологий при более разумном и энергичном подходе может привести к совершенно иному результату: устойчивому переизбытку чистой энергии, здоровому питанию, материальным благам, отличному здоровью, всестороннему интеллекту, динамичному творчеству и глубокому сотрудничеству.

В-четвертых, наибольшее влияние на то, какой результат будет достигнут, оказывает широкое распространение трансгуманизма. Это, в свою очередь, включает в себя три направления деятельности:

– Пропаганда трансгуманистической философии как всеобъемлющего мировоззрения, которое поощряет и вдохновляет каждого присоединиться к следующему скачку вверх по великой эволюционной лестнице жизни: мы можем и должны развиваться до более высоких уровней, физически, умственно и социально, используя науку, технологии и рациональные методы.

– Распространение трансгуманистических идей на реальную политическую деятельность, чтобы противостоять крайне деструктивным тенденциям в этой сфере. – – В основе всех вышеперечисленных инициатив – преобразование мира образования, чтобы дать каждому человеку навыки, подходящие для совершенно иных обстоятельств ближайшего будущего, а не для потребностей прошлого.

И, наконец, над только что описанным судьбоносным переходом нависает потенциал еще большего изменения, при котором технологии будут двигаться вперед еще быстрее, с появлением самосовершенствующегося искусственного интеллекта со сверхчеловеческим уровнем способностей во всех аспектах мышления.

Это подводит нас к теме сингулярности.

Сингулярность – это момент времени, когда искусственный интеллект, возможно, возьмет на себя управление миром вместо человека. Тот факт, что Сингулярность может произойти в течение нескольких коротких десятилетий, заслуживает того, чтобы о нем кричали с крыш. Именно так я и поступаю, иногда. Это делает меня сингуляритаристом.

Но это не значит, что я или другие люди, которые пытаются привлечь внимание к этой возможности, подпадают под какую-либо из черт “Тени сингулярности”. Это не значит, например, что все мы благодушно относимся к рискам или считаем, что Сингулярность неизбежно благотворна для человечества.

Итак, сингуляритаризм (S) – это не проблема. Трансгуманизм (Т) – не проблема. Также, если уж на то пошло, проблема не кроется в основных убеждениях E, C, R или EA частей предполагаемой связки TESCREAL. Проблема кроется где-то в другом.

Что нас должно беспокоить: не TESCREAL, а CASHAP

Вместо того чтобы зацикливаться на предполагаемом поглощении Кремниевой долины компанией TESCREAL, вот что нас должно волновать на самом деле: CASHAP.

С означает “сократизм” – тенденция объединять идеи, которые не обязательно должны быть вместе, не замечать вариаций и сложностей в людях и идеях, а также настаивать на том, что основные ценности группы могут быть принижены только потому, что некоторые периферийные члены имеют неприятные убеждения или взгляды.

(Примечание: в то время как поклонники концепции TESCREAL виновны в сократизме, моя альтернативная концепция CASHAP отличается от нее. Я не предлагаю, чтобы идеи в ней всегда были вместе. Каждая из отдельных идей, составляющих CASHAP, является пагубной).

А – акселерация – стремление к тому, чтобы новые технологии разрабатывались и внедрялись как можно быстрее, при безответственной вере в то, что любые недостатки, возникающие на пути, всегда можно легко исправить в процессе (“двигайся быстро и ломай вещи”).

S означает “преемственность” – мнение, что если сверхразумный ИИ вытесняет человечество из-под контроля планеты, то эта преемственность должна автоматически приветствоваться как часть великого эволюционного процесса – независимо от того, что происходит с людьми в процессе, независимо от наличия у ИИ разума и сознания, и даже независимо от того, уничтожают ли эти ИИ себя и планету.

H означает “hype” – слишком легкая вера в идеи, потому что они соответствуют вашему уже сложившемуся представлению о мире, вместо того чтобы использовать критическое мышление.

AP означает “антиполитика” – вера в то, что политика всегда ухудшает ситуацию, мешая инновациям и творчеству. На самом деле хорошая политика сыграла невероятно важную роль в улучшении условий жизни человека.

Заключение

В заключение этой статьи я хотел бы подчеркнуть положительные противоположности нежелательным чертам CASHAP, которые я только что перечислил.

Вместо сократительства мы должны быть готовы к расширению нашего мышления и к тому, что наши идеи будут оспариваться. Мы должны быть готовы находить новые важные идеи в неожиданных местах – в том числе у людей, с которыми у нас много разногласий. Мы должны быть готовы время от времени откладывать свои эмоциональные реакции на потом, поскольку наши прежние инстинкты отнюдь не являются безошибочным проводником в грядущие бурные новые времена.

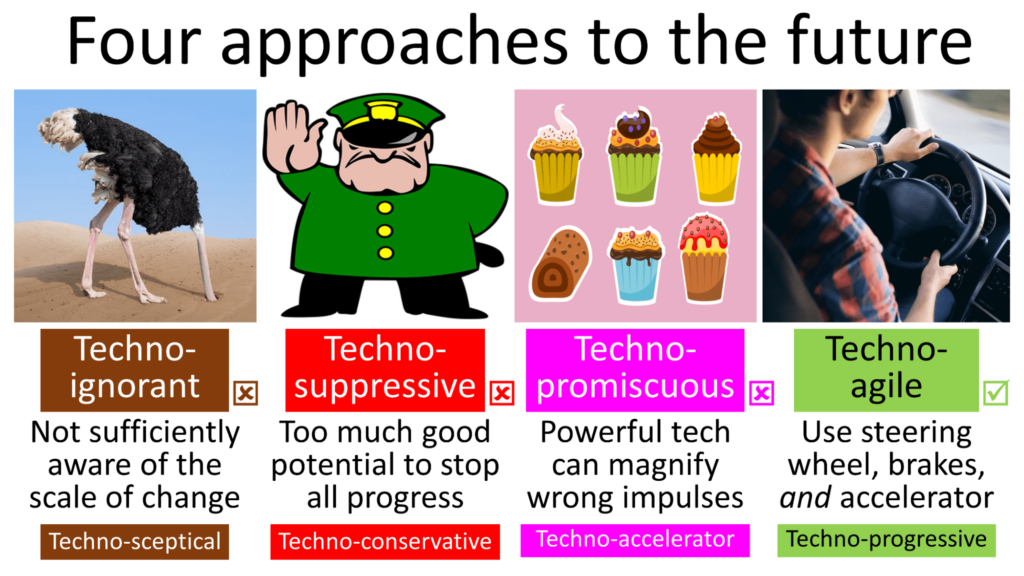

Вместо акселеризма мы должны использовать более сложный набор инструментов: иногда тормозить, иногда ускоряться, а также много рулить. Это то, что я назвал технопрогрессивным (или техноагильным) подходом к будущему.

Вместо преемственности мы должны принять трансгуманизм: мы можем и должны поднять сегодняшних людей на более высокий уровень здоровья, жизненной силы, свободы, творчества, интеллекта, осознанности, счастья, сотрудничества и блаженства. И прежде чем нажимать на кнопки, которые могут привести к вытеснению человечества сверхразумными ИИ, способными положить конец нашему процветанию, нам нужно тщательнее изучить целый ряд вопросов!

Вместо шумихи мы должны вновь приступить к критическому мышлению, осознавая любые тенденции к ложным выводам или придавая слишком большое значение выводам, которые являются лишь предварительными. По сути, это главная идея R (рационализма) в TESCREAL, что делает еще более “сумасшедшим городом” то, что R презирают за чрезмерное упрощение.

Мы должны прояснить и защитить то, что называют “узким путем” (или, иногда, просто “политикой будущего“) – то, что находится между государствами, имеющими слишком мало власти (оставляя общества заложниками разрушительных раковых опухолей, которые могут расти в нашей среде) и имеющими слишком много власти (не имея противовеса в виде “сильного общества”).

.png)

.png)

.png)